”spark streaming“ 的搜索结果

本文主要从以下几个方面介绍SparkStreaming: 一、SparkStreaming是什么 二、SparkStreaming支持的业务场景 三、SparkStreaming的相关概念 四、DStream介绍 五、SparkStreaming的机制 六、SparkStreaming的Demo...

在数据流处理过程中,Spark Streaming会将数据流分成小的批次,并在每个批次完成后进行检查点操作,以确保数据的可靠性和一致性。批处理和流处理的无缝切换:Spark Streaming可以将实时数据流转换为小批量的数据流,...

一个完善的Spark Streaming二次封装开源框架,包含:实时流任务调度、kafka偏移量管理,web后台管理,web api启动、停止spark streaming,宕机告警、自动重启等等功能支持,用户只需要关心业务代码,无需关注繁琐的...

HBase-SparkStreaming 从HBase表读取并写入HBase表的简单Spark Streaming项目 #Prereqs运行 创建一个要写入的hbase表:a)启动hbase shell $ hbase shell b)创建表create'/ user / chanumolu / sensor',{NAME =>'...

java的sparkstreaming连接kafka的例子,kafka生产者生产消息,消费者读取消息,sparkstreaming读取kafka小区并进行存储iotdb数据库。

生成的数据主要是模拟某学习网站学习视频课程的访问量(其中*以“ / class”开头的表示实战课程,然后通过流水线Flume + Kafka + SparkStreaming进行实时日志的收集,HBase来存储数据)*注意事项(使用的软件工具及...

支持动态调节 streaming 的 批次间隔时间 (不同于sparkstreaming 的 定长的批次间隔,StructuredStreaming中使用trigger实现了。) 支持在streaming过程中 重设 topics,用于生产中动态地增加删减数据源 添加了速率...

spark stream教程及demo

目前实时平台主要基于JStorm与SparkStreaming构建而成,本次分享将着重于介绍携程如何基于SparkStreaming构建实时计算平台,文章将从以下几个方面分别阐述平台的构建与应用:携程实时平台在接入SparkStreaming之前,

spark streaming

标签: spark

spark streaming spark流式计算 Spark Streaming 是Spark核心API的一个扩展,可以实现高吞吐量的、具备容错机制的实时流数据的处理。支持从多种数据源获取数据

Spark-Streaming简单小项目 Spark Streaming实时解析flume和kafka传来的josn数据写入mysql 注意,以下文件不提供 配置c3p0-config.xml链接,链接数据库 配置log4j.properties、my.properties 另,还需将您的spark和...

1.理解Spark Streaming的工作流程。 2.理解Spark Streaming的工作原理。 3.学会使用Spark Streaming处理流式数据。 二、实验环境 Windows 10 VMware Workstation Pro虚拟机 Hadoop环境 Jdk1.8 三、实验内容 (一)...

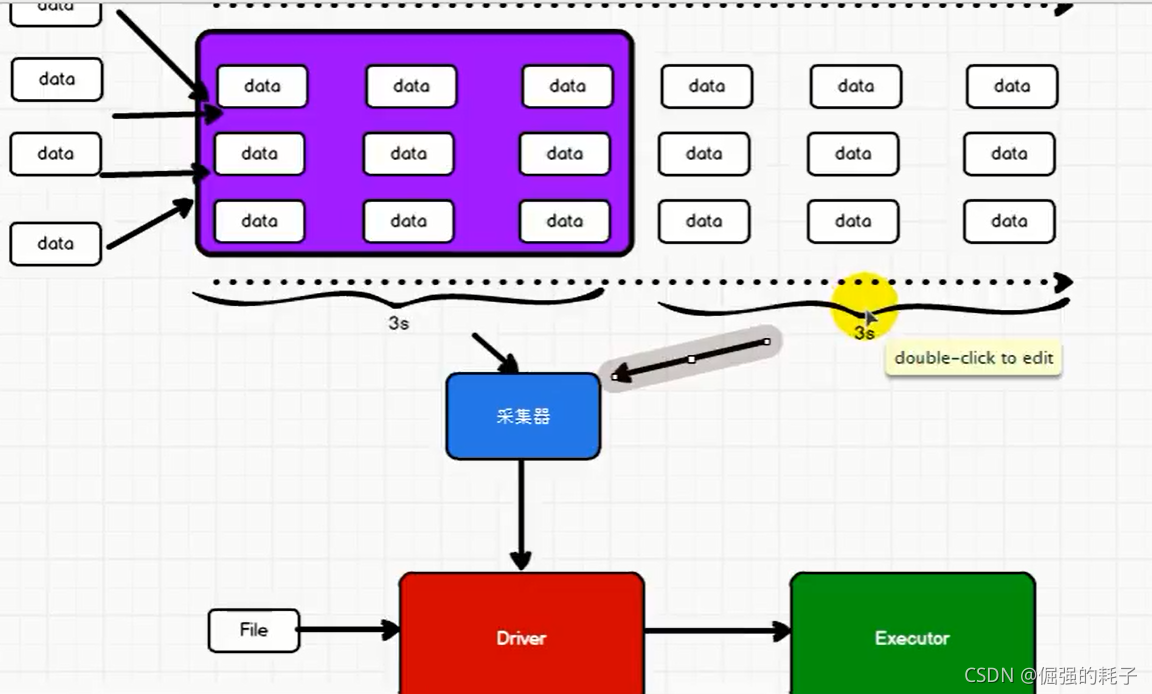

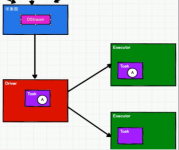

DStream是Spark Streaming中的一个最基本的抽象,代表了一系列连续的数据流,本质上就是一系列的RDD。StreamingContext会根据设置的批处理的时间间隔将产生的RDD归为一批,这一批RDD就是一个DStream,该DStream里面...

Spark streaming tutorial, with advanced analysis.!

(1)利用SparkStreaming从文件目录读入日志信息,日志内容包含: ”日志级别、函数名、日志内容“ 三个字段,字段之间以空格拆分。请看数据源的文件。 (2)对读入都日志信息流进行指定筛选出日志级别为error或warn...

java-sparkstreaming-kinesis 这个项目是用Java运行一个Spark Streaming应用程序 mvn clean compile assembly:assembly >> 使用 deps 构建 jar spark-submit --class ...

SparkStreaming是Spark核心API的扩展,用于可伸缩、高吞吐量、可容错地处理在线流数据。SparkStreaming可以从很多数据源获取数据,比如:Kafka、Flume、Twitter、ZeroMQ、Kinesis或TCP连接等,并可以用很多高层算子...

1.什么是SparkStreaming?2.SparkStreaming可以接受那些数据源?3.Dstream,我们可以进行哪两种操作?Sparkstreaming:构建在Spark上处理Stream数据的框架,基本的原理是将Stream数据分成小的时间片断(几秒),以...

spark-mqtt-sample 使用Spark Streaming的简单MQTT客户端

Spark Streaming 是 Spark 核心 API 的一个扩展,可以实现高吞吐量的、具备容错机制的实时流数据的处理。 Spark Streaming 支持从多种数据源获取数据,包括 Kafka、Flume、Twitter、ZeroMQ、Kinesis 以及 TCP ...

本文详细的介绍了sparkstreaming的基本概念,如何使用等问题

在WeTest舆情项目中,需要对每天千万级的游戏评论信息进行词频统计,在生产者一端,我们将数据按照每天的拉取时间存入了Kafka当中,而在消费者一端,我们利用了sparkstreaming从kafka中不断拉取数据进行词频统计。...

Spark Streaming把统计结果写入到数据库里面 可视化前端根据:yyyyMMdd courseid把数据库里面的统计结果展示出来 选择什么数据库作为统计结果的存储呢? RDBMS:MySQL.Oracle… day course_id click_count ...

SparkStreaming 运行集群 ./sbin/start-master.sh 运行工作进程 ./bin/spark-class org.apache.spark.deploy.worker.Worker spark://linuxmint-virtual-machine:7077 --cores 4 --memory 2G 运行TCP服务器 java -cp...

SparkStreaming是建立在Spark上的实时计算框架,通过它提供的丰富的API、基于内存的高速执行引擎,用户可以结合流式、批处理和交互试查询应用。本文将详细介绍SparkStreaming实时计算框架的原理与特点、适用场景。...

基于 Flume+ Kafka+ Spark Streaming 实现实时监控输出日志的报警系统的 Spark Streaming 程序代码。 基于 Flume+Kafka+Spark Streaming 实现实时监控输出日志的报警系统的 Spark Streaming 程序代码,博客链接: ...

推荐文章

- java持续集成soapui_集成testNG到JavaAPI测试-执行多条用例-程序员宅基地

- 【007】基于Vue.js的通讯录管理系统(含源码、运行教程)_vue通讯录管理-程序员宅基地

- 在Windows命令行中编译运行C/C++程序_window c++代码编译-程序员宅基地

- 设计模式之Template Method模式(Lua版和C#版)_public abstract void destroy(t self); c#-程序员宅基地

- 地图二三维联动原理_二三维联动显示怎么实现-程序员宅基地

- 双系统-Ubuntu安装错误(使用EasyBCD安装Ubuntu16)_can't open /dev/sdb:no medium found-程序员宅基地

- 虚拟机克隆很慢的一种原因_qemu-img convert 克隆-程序员宅基地

- 第12章工程中的 Linux设备驱动之Linux 设备驱动的电源管理_ddp_module_clk_disable-程序员宅基地

- 交换网络安全性_pvlan 跨交换机-程序员宅基地

- 解决py2neo操作Neo4j出现The client is unauthorized due to authentication failure.的方法_py2neo.errors.clienterror: [security.unauthorized]-程序员宅基地